API 访问 目前,DeepSeek API 已同步上线 V4-Pro 与 V4-Flash,支持 OpenAI ChatCompletions 接口与 Anthropic 接口。访问新模型时,ba...

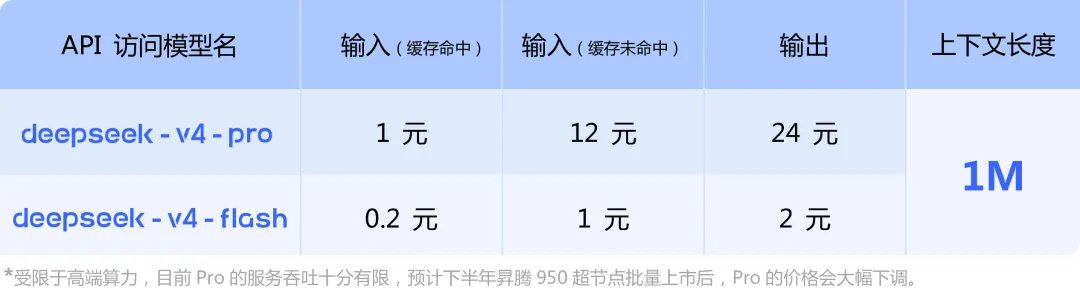

目前,DeepSeek API 已同步上线 V4-Pro 与 V4-Flash,支持 OpenAI ChatCompletions 接口与 Anthropic 接口。访问新模型时,base_url 不变, model 参数需要改为 deepseek-v4-pro 或 deepseek-v4-flash。

V4-Pro 与 V4-Flash 最大上下文长度为 https://t.co/gIAN2kB7ZS" / X

Post

Conversation

API 访问 目前,DeepSeek API 已同步上线 V4-Pro 与 V4-Flash,支持 OpenAI ChatCompletions 接口与 Anthropic 接口。访问新模型时,base_url 不变, model 参数需要改为 deepseek-v4-pro 或 deepseek-v4-flash。 V4-Pro 与 V4-Flash 最大上下文长度为 1M,均同时支持非思考模式与思考模式,其中思考模式支持 reasoning_effort 参数设置思考强度(high/max)。对于复杂的 Agent 场景建议使用思考模式,并设置强度为 max。模型调用与参数调整方法请参考 API 文档: api-docs.deepseek.com/zh-cn/guides/t 请大家注意:旧有的 API 接口的两个模型名 deepseek-chat 与deepseek-reasoner 将于三个月后(2026-07-24)停止使用。当前阶段内,这两个模型名分别指向deepseek-v4-flash 的非思考模式与思考模式。 开源权重和本地部署 DeepSeek-V4 模型开源链接: huggingface.co/collections/demodelscope.cn/collections/de DeepSeek-V4 技术报告: huggingface.co/deepseek-ai/De